工业视觉本质上是模拟人类“眼睛+大脑”的协作。本文通过我入行以来的深度复盘,系统性地拆解了光学成像、光源打光及组装调试的实战逻辑。

针对行业内“4 小时准备,17 秒魔法时刻”的低效痛点,我从跨界思考者的视角提出了对制造业转型升级的独特洞察。拒绝空泛概念,我致力于通过对“伪需求”和“难交付”问题的实战反思,寻找认同底层逻辑的合作伙伴,共同探索 AI 视觉在制造一线真正落地的可能性。

01 熟悉的双眼,陌生的视觉

本质上,工业视觉是一种模拟人类「眼睛+大脑」的存在形态,让机器能够“看清”流水线生产的物品,同时还能识别分类、检测缺陷或测量尺寸。

但是,这个有点内行的解释实在太乏味了!我们可以换个视角,假设你来亲自体验这项技术,看看工业视觉到底在做什么。

在开始之前,我们先看看工业视觉检测这个东西内部有哪些组成部分:光学成像、检测软件(算法)、数据传输、触发与执行一共四个模块,从字面上看,这四个部分没有什么关联,像是凑在一起的临时组合。

扒开外皮直接看内核,就会发现它们是我们特别熟悉的组合,人类的眼、人类的脑、人类的神经、人类的手(腿)。我们每天每时每分都在用它们,帮我们找手机、选外卖、挑水果……

好比我今天早上去公园遛弯,视线里飘入一片美美的花,我的眼睛好奇地盯着,大脑发出“靠近她”的讯号,神经系统把这这句话传给了手和腿。我快步向前,走进一看:黄色花瓣呈尖状细条状,花蕊中间是一团青黄色,然后我辨认出这是一朵菊花。

这个生活场景你肯定秒懂,马上进入了 make sense 状态,那么接下来就能进一步探究:用工业视觉来做什么事?我作为主人公带你走进车间实验室,近距离体验一次。

02 恶补:所有你该知道的

碰壁的开始,好奇的驱使

入行第一天,我脑子里有很多问号,千头万绪不知道从哪入手才是正确的打开方式。我很纠结,没办法,到处问工业视觉可以应用在哪些场景?用它来解决什么问题?解决方案和技术是什么?最后带来了多大的收益和价值?

这套组合问题实在太宏大,很难用一两句话说清楚,恐怕得让老同行把自己所有看家本事和压箱底经验都翻出来才能给出非常饱满的回答。显然,我没有得到想要的答案,收到的是一堆资料和建议,比如:“这些资料你先了解一下,看一看大概就知道了”。然而,光看资料是没有用的,这个时候需要有目的地阅读,那么我必须带着最核心最重要的问题投入这片知识的海洋。

于是,我开始自己琢磨应该从哪个问题开始。灵光一闪,突然想起一部创业纪录片的主人公为了了解这门生意值不值得做,他会先搞懂:我想做的这门生意究竟在做一件什么事?我也跟着学,带着这个问题开启了疯狂自学之路。整整两个星期,一直在沉浸式受虐。

弄懂工业视觉成像原理

首先,我从销售BD的角色转换为一名严谨的视觉工程师。工欲善其事必先利其器,我得懂些原理才能用得了这个“器”。至于学习素材,我只是粗略浏览了几份公司内部资料,反而是从B站上找了些摄影博主、工业视觉讲师的视频,进行深度学习和理解。然后再跟同事请教,问一些针对性的细节问题和行业知识,基本上把「工业视觉成像」这块入行最难啃的硬骨头给嚼了下来。以下说说我理解的原理:

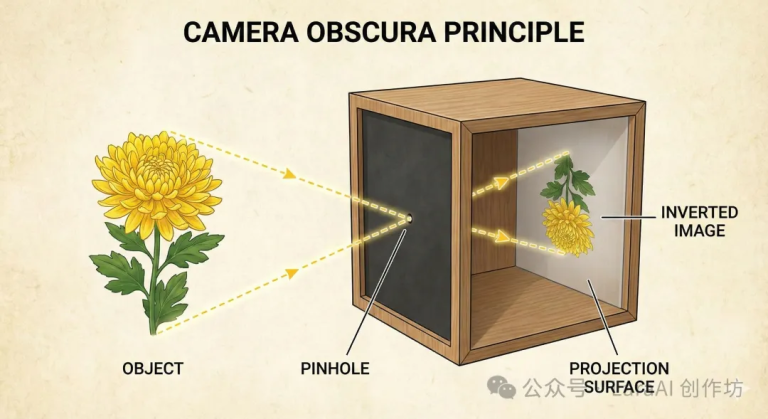

基本原理——小孔成像

所有的相机成像都是基于「小孔成像」这个基础原理构造而成。这个原理在中学时代学过,只不过我已经忘了,现在重新学一遍。

我想象出这样一幅画面,假设刚才提到的那朵菊花是“拍摄物”,我举起拍立得相机准备拍照,圆圆的镜头就是那个“小孔”,我调整好距离确保对焦,按下拍照的快门,不一会儿一张相纸弹出,一张菊花的照片就显影出来。我向自己提了一个问题:为什么能够拍出这张菊花的照片?找到的回答是,成像利用了光的特性。(以下知识点起到科普和铺垫的作用,不想读原理和概念部分的话,可以直接跳到“03 理解:在对比的差异间”继续阅读。)

我们知道,光是走直线的,菊花表面的每一处都能反射光,有些光朝着小孔的方向扩散射出,汇聚到“小孔”内的镜片上,由于玻璃镜片能让光发生折射,这些光的行动轨迹同时发生了对称性的改变,以更短的路径再一次汇聚后映射到相机的成像区域,相纸也因为曝光发生了化学反应,显现出一朵同比例缩小的菊花“像点”。

光运动的路径,实际上是把“拍摄物、小孔、像点”连在一起,组成了非常多的相似三角形组,可以用数学公式计算成像的关键参数值,比如镜头的物距、焦距、像距、分辨率、视野等。这些参数彼此制约、动态组合,它们之间遵循着这样一个逻辑:镜头焦距固定的情况下,离拍摄物越近,像点越大,更适合拍特写或局部,背景模糊;离得越远,像点越小,更适合拍全景,背景更清楚。跟人眼看东西的效果是一样的,符合我们的直觉。

景深——印象太深

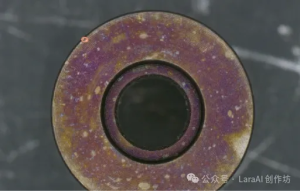

分辨率低、焦距虚焦会让图片不清晰,可是还有一个关键概念,就是「景深」,直接影响图像背景细节的清晰度。如果我们拍摄的物品有高低深度,比如一个手机充电器的USB口,高差0.7~0.9 mm,如果相机的景深不够覆盖这个高差,那么我们拍出的照片可能是这样的:1)USB 金属片以及表面清晰,底部区域模糊;2)USB底部清晰,表面模糊。也就是说,我们无法得到一张USB口表面和底部都清晰的图片。

对于工厂来说,选用的光学相机景深不够,导致机器看不清底部,出现漏检 30% USB口毛刺和底部异物——这直接导致客户退货率飙升,假设每1000件就有10件被退回,该批次月产量10万件,售价99元,损失超99999元。

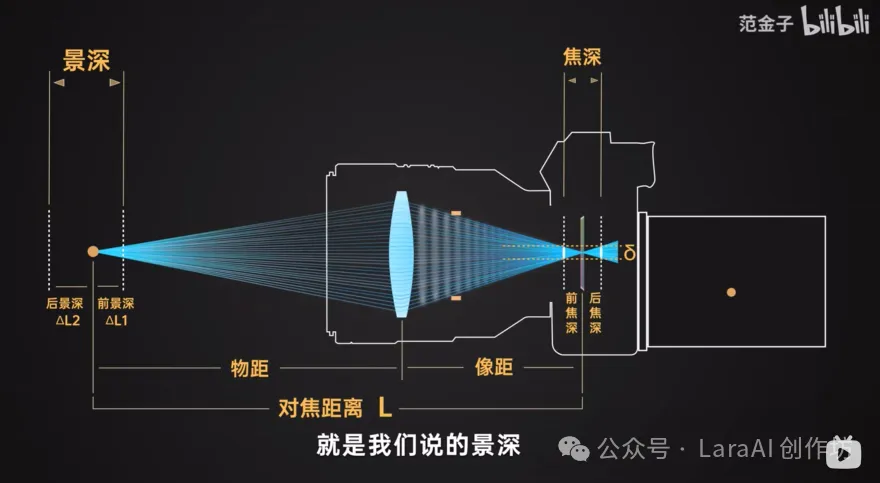

说个插曲小故事。我第一次被挑战和质疑,就是因为不懂景深。但我这个人有点要强,偏偏不想被人看轻,那一刻的羞愧反而激起了我的好胜心,必须彻底搞懂景深是怎么回事!下面有张我当时看视频截的图,视频和原理图反复看了好几遍,花了一个小时琢磨,终于通了!

原来景深不够,导致图像模糊是因为「焦深」,它俩是一对孪生兄弟,只不过我看到了显性的景深,却没看到相机内部隐形的焦深。直接影响景深的是弥散圆大小,用大白话说,就是相机传感器本身可容许的往前或前后的误差范围。

从景深原理图可以看出,焦深的中心点是成像最清晰的位置,但是前后各有一小段可修正图像的空间,只要不超过这个区间,那么这些光的信息能够被清晰显露,否则就会变成加了马赛克的背景。而为了让景深兼容更大的深度差场景,我们可以选择更远的物距或更长的镜头,这样便能缩小两个相似三角形两端的夹角,那么焦深的区间就可以分别往左或往右移动,加大这个容错区间,景深也就变大了。

03 理解:在对比的差异间

铺垫了那么多原理和理论的前戏,终于可以进入正题了。用工业相机拍照到底怎么拍,怎么操作,这个过程包含哪些步骤?我会根据复杂度和时间长短进行评估和对比。

数码相机拍照 📷

先说普通人玩的数码相机。入行前,我也偶尔玩一玩摄影,出去旅游或者出街的时候,用一台SONY相机拍拍照。操作很简单,模式打到自动档(AUTO),举起相机对焦,按下快门,出片,三步搞定!总共2s。

不过,我还跟以前无人机公司的同事偷学了一手,光线太暗的话换到P档(程序自动),只多一步: ISO 调节;光线参数大概800-1500吧,试拍几张就找到了诀窍,出片也能很快搞定。最多5s。

工业视觉成像 🤖

面对用工业相机拍照时,我手足无措、一头雾水,只好硬着头皮硬上。我把这个复杂的事情拆分、分解,找到那个最容易入手的地方,按照步骤和顺序一个个搞定它们。

步骤一:配置相机镜头→算参数、选硬件

首先,相机上没有快门按键,根本没法手动操作。还有,相机和镜头都得单独选型和配置,相机选 5MP or 25MP?镜头用25mm or 50mm or 其他?根据什么条件来定?都要较为精准地计算和评估。只有选对了相机和镜头,调出合适的参数,才能保证精度和清晰度。第一次我花了1个小时。

为了缩减这类重复性工作,我给自己做了一张自动计算表(额外花了一个下午),输入产品尺寸和最小可检出尺寸,可以自动计算相关参数,专门解决选型和定参的问题(可关注微信公众号“LaraAI 创作坊”,私信“参数配置表”可获得;或点击咨询、邮件获取)。

步骤二:光源与打光→布光是成像的灵魂

另外,拍工业产品必须单独加“闪光灯”——(我的数码相机自带闪光,完全省去这一步)。选一款合适的光源,颜色选白光 or 黄光?类型选穹顶型、环型、条型还是方型?(甚至还有内窥镜的样式)

重头戏在于:根据产品材质、缺陷特征、分布位置综合考虑打光和布局。用高角度做明场,还是用低角度做暗场,要不要加个背光拍轮廓?总之一句话,就是得把需要拍摄的产品表面内外360°全部照亮,确保亮度均匀无死角,并且还要防环境光干扰。第二步现学现用也花了1小时。不过我觉得这一步的工作也可以用定性和定量的方式优化,后续我会考虑弄个解决方案。

这个环节,我称之为“光的输入”,布光是成像的灵魂,决定项目的成败;而相机是光的捕手,决定成像的质量。

步骤三:组装和调试→理论到现实的桥梁

这一通选型搞定,下一步就是组装相机、镜头、光源——(对比起来,数码相机拿来即用,易用性简直完爆复杂繁琐的工业品)。我遇到的视觉项目,全是非标的,所以光学成像设备都是按需配置,现装现用。虽然都是些事务性的动手工作,但把光学成像理论落地为现实可采集的设备与系统,一点也不能马虎,必须细致、全面、精准。

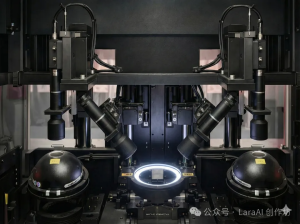

一般情况下,光学设备会装在固定支架上,相机镜头垂直置于检测产品的正上方,上下调整相机设备与产品之间的工作距离,调试到视野略宽于产品拍摄区域20%的大小,且清晰对焦即可。关于打光,则根据缺陷分布的位置,分布式安装在不同的方位。这是一个实操性强、动态组合的手艺活,具体实例会专门写一篇文章介绍。

至于工业相机没物理按键怎么才能拍照呢?实际上是通过电脑端的软件来控制拍摄,需要用专业线缆把相机、光源控制器跟电脑主机连接上,这样就能实现数据传输,包括拍摄图像的信号和传输图像的信息。如果是在平时测试或者POC,用鼠标点击拍照按钮是可以的;要是在自动流水线上架设的话,就需要跟PLC连通,通过触发信号实现自动拍摄,实时取图。

这一步用时最长,2个小时。大量的工作是在测试和调试打光的效果、相机拍摄的角度,尽可能让每个部位的缺陷都能被完美呈现。另一方面,正因为调试环节的每一步都依赖人工经验调参,所以很难避免失误,导致大量项目“Demo很美,量产翻车”——这也是为什么企业需要像我这样的独立顾问,在早期就介入评估风险和可行性。

顺利完成这三步,工业相机成像过程就从看得见的“物理世界”转向抽象的“数字空间”,也就是拍照、出图,以及输出判定结果(机器自主决策)。

步骤四:成像与检测 → 机器的大脑登场

最后这一步,可以分解为四个关键动作:曝光、快门、成像、检测。工业视觉的终极目标,拿到产品检测结果,区分良品和不良品。(就像我日常拍片一样,得看一眼图好不好看,只留最美的瞬间)

前三个动作:曝光 & 快门 & 成像

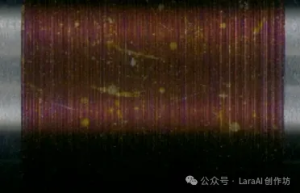

检测的产品就位,视觉设备触发拍摄。我手拍的第一个产品是圆柱电枢(汽车某个小零件),圆柱两个端面和柱状表面全拍,靠手切换不同区域,采集8次完成。两种打光组合交替拍,一组高角度明场和一组左右低角度暗场,相当于拍一个完整的产品需要16张图片。

那么拍摄到成像,输出一张图片能有多快?几乎同时,间隔时间约10ms~20ms,肉眼不太能察觉到明显延时。光源频闪(一直闪),一张图曝光 0.2ms/次,信息处理与成像的时间大约10-15ms,然后就能看到一张彩色的产品图片。

如果想要对这张拍好的图片加工优化,那么软件是可以在数字空间里处理的,需要几毫秒到几十毫秒不等。对于多重复杂的缺陷检测场景,图像后处理是很有必要的,但是缺点也很明显,就是会拖慢整体节拍(时间)。

至此,一张比人眼目视更清晰、高保真的工业视觉图片闪现!你在显示器上能够看得一清二楚,一处比头发丝还细的划痕极其明显,原本肉眼看不见碰伤的小凹坑也在这时显现,因为它们被放大了几十倍。拉到最大倍可以看到一个个小方块,那是图像上最小的颗粒——像素,5MP 相机拍出来的照片就有500万颗像素点。

最后的动作:检测

我们的工作已经完成了99%,还有最后一个动作,机器自动识别和判断产品表面是否有瑕疵。又快有准的视觉大脑终于上场,划痕和凹坑的这两张图片会被判定为不合格,出现红色的NG拦截,如果是良品图片则会输出绿色的OK放行。

这个过程大约是在100~200ms 内完成,算法运算和响应极其迅速。要是一张图片上有几种或者数量更多的缺陷需要被同时检出,那么就很考验这套算法的能力和性能边界,大多数情况下 0.5~1.0s 内可以完成。当然,软件算法能力差的可能会直接报错、崩溃,或者宕机。(软件算法的效能表现将在下一篇文章深入探讨)

好在,我们成功了。内心有点小激动,我们第一次用工业视觉设备完成了产品自动检测!第四步时间最短,居然只用了0.2s!可是,产品拍了8次,这个动作就得重复8次,那么完整的产品全检时长为1.6s。还有,不能漏掉我手动换拍8次的耗时,就算15s。单个产品全检节拍:1.6s+15s=16.6s,四舍五入总计 17s。

| 工业视觉成像 | 数码相机拍摄 | ||

|---|---|---|---|

| 复杂度 | 从0到1做一桌10人份年夜饭 | 加热一份1人食预制菜 | |

| 使用难度 | 两周以上沉浸式魔鬼训练 | 无门槛,零基础可上手 | |

| 关键步骤 | 4大步骤,像长篇报告一样的指导手册 | 1个动作 | |

| 拍摄方式 | 触发自动取像 | 手动快门拍摄 | |

| 单张时长 | 0.2s | 2s | |

| 准备时长 | 4小时,240分钟 | 零,拿来即用 |

总结对比--AI Vision Acquisition & Consumer Photography

一句话总结:昨天的我只需要花2分钟加热一份1人食预制菜当晚饭,今天却要在一个下午从0到1完成一桌10人份的年夜饭,最后还写了一份专业长篇报告做个总结。

你会发现,绝大多数时间花在了准备和调试,以及一些事务性的dirty work或paper work,起码4个小时,240分钟。最后的魔法时刻,只体验了短暂的17s,感觉比看个烟花还短。

这些“脏活累活”的效率,不仅决定了整个项目的ROI,而且直接关系到设备能不能用的起来——这正是为什么企业需要第三方顾问。

04 洞察:行业转型需要新鲜血液

我想,这些费时费力大量没有标准化的事情确实带来了商业机会。上游的相机、镜头、光源硬件厂商造了几十上百种产品,提供解决方案的设备商、集成商靠接各种项目存活,甲方则是为项目需求买单的制造工厂,那些生产出来的成品卖给了个人消费者和企业,这样刚好构成了一个完整的生态。

然而,消费者变得更加理智,必需的物品买质量好的,想买的东西又要好玩的,没什么用的一律不买。我接触的3C电子、汽车、医疗这三个行业已经反映了这个趋势。所以工厂必须靠质量、靠创意、靠个性化打动消费者。质量方面,他们如果还用原来那套落后的检测技术和生产工艺,恐怕会丢掉那些最优质的客户,东西卖不出去,还占用了大量资金和库存,那就很容易倒闭破产。这么看来,制造业转型升级是必经之路。

谁能为工厂侧提供实实在在解决问题的产品和服务,在战略上与工厂一起探索成功的道路,那么Ta 本身也需要转型升级。而行业内具备这种战略的公司和个人确实很少,或者说拥有这种属性的企业和个人太稀缺了。

好在,真有人想要试试的话,只要找准一个场景,可以借助 AI 技术去快速验证,而我就是其中之一。我相信,工业视觉在AI(机器学习和深度学习)的加持下,在质量检测方面有更大的提升效果,它正在重塑以前AOI 检测、传统算法做不到的事。

我在寻找认同这套底层逻辑的合作伙伴,而不仅仅是一个生产制造的企业客户,否则也不可能成为我的客户。还有,我同样需要有技术有想法的企业伙伴。一个人总有局限,而一个团队可以互补,突破限制。

如果你是制造企业管理决策人、技术负责人或自动化设备负责人,正在评估或遭遇工业视觉项目落地的挑战,无论是前期方案选型、中期技术验证,还是后期效果优化,我的这段“新人历险记”所积累的一手经验,或许能为您提供一份客观、中立的风险评估与决策参考。

Lara AI Works

I help teams avoid costly mistakes before industrial AI projects go live.

我站在项目之外,帮你避免 AI 视觉项目失败。